Rapport du ratissage du GPEN : La protection de la vie privée des enfants

Mars 2026

Rédigé par les coordonnateurs centraux du ratissage :

Commissariat à la protection de la vie privée du Canada

Commissariat à l’information du Royaume-Uni

Autorité de protection des données du bailliage de Guernesey

Sur cette page

Contrôle de l’âge (indicateur 1)

Approches en matière de contrôle de l’âge

Mécanismes de contrôle de l’âge observés dans le cadre du ratissage

Contournement du contrôle de l’âge

Contenu inapproprié et traitement des données à haut risque

Qu’est-ce qui a changé au cours de la dernière décennie?

Collecte de données sur les enfants et mesures de protection (indicateurs 2 et 3)

Collecte de renseignements personnels

Suppression de compte (indicateur 4)

Pourquoi la suppression de compte est-elle importante pour les enfants?

Ce que les ratisseurs ont observé

Qu’est-ce qui a changé au cours des dix dernières années?

Exposition à du contenu préjudiciable

Quand contenu préjudiciable et éléments à risque se rencontrent

Risques liés aux services destinés aux enfants

Adaptation générale à l’utilisation par les enfants

Comparaison des sites Web et des applications

Contexte

Le ratissage de 2025 du Global Privacy Enforcement Network (GPEN) a eu lieu pendant la semaine du 3 au 7 novembre 2025.

Le ratissage a permis de vérifier comment les sites Web et les applications mobiles utilisés par des enfants recueillent les renseignements personnels les concernant, font preuve de transparence quant à leurs pratiques en matière de protection de la vie privée, mettent en place des mécanismes de contrôle de l’âge et utilisent des mesures de protection de la vie privée pour limiter la collecte de données. Certaines applications et certains sites Web qui ont été examinés sont spécialement conçus pour les enfants, tandis que d’autres s’adressent au grand public, mais sont particulièrement populaires auprès des enfants et des jeunes.

L’espace numérique d’aujourd’hui occupe une grande place dans la vie des enfants, leur offrant des occasions de s’exprimer, d’apprendre, de socialiser et de tisser des liens avec leur collectivité. Les services en ligne qui ne prennent pas en considération l’intérêt supérieur des enfants peuvent exposer les jeunes à des risques comme le suivi en ligne, le profilage, le ciblage et l’exposition à du contenu inapproprié ou préjudiciable.

Le ratissage de 2025 marquait le 10e anniversaire d’un examen semblable de la protection de la vie privée des enfants mené par le GPEN en 2015. Il a donc été possible de comparer la façon dont les services en ligne protégeaient les enfants et utilisaient leurs données à l’époque, et comment ils le font une décennie plus tard.

Le ratissage a été coordonné par le Commissariat à la protection de la vie privée du Canada, le Commissariat à l’information du Royaume-Uni et l’Autorité de protection des données du bailliage de Guernesey (les coordonnateurs centraux du ratissage).

Au total, 27 autorités d’application des lois en matière de protection de la vie privée de partout dans le monde (voir l’annexe 1) ont participé au ratissage de 2025 et examiné 876 sites Web et applicationsNote de bas de page 1.

Le présent rapport a été rédigé par les coordonnateurs centraux du ratissage. Il présente les conclusions et l’analyse des autorités qui ont participé au ratissage. Il ne vise pas à refléter le point de vue de l’ensemble des membres du GPEN ou de toute autre autorité particulière.

Le ratissage du GPEN n’est pas en soi une enquête et il ne vise pas à identifier de façon définitive les problèmes de conformité ou les infractions aux lois. Les préoccupations soulevées dans le cadre de cet exercice peuvent aider à améliorer l’élaboration d’orientations ciblées, les consultations futures avec les organisations et l’adoption d’éventuelles mesures de mise en application des lois.

Méthodologie

Dans le cadre du ratissage, les participants, aussi appelés « ratisseurs », devaient reproduire l’expérience utilisateur en interagissant avec des sites Web et des applications utilisés par les enfants et recueillir de l’information sur leurs pratiques actuelles en matière de collecte de données et de protection de la vie privée en ligne. Nous avons ainsi pu comparer nos résultats avec ceux qui avaient été obtenus lors du ratissage de 2015, lorsque c’était pertinent. Bien que ces observations et comparaisons soient révélatrices, le ratissage n’a rien d’une étude scientifique.

Les coordonnateurs centraux du ratissage ont préparé une série d’instructions et de questions connexes pour guider les ratisseurs lors de leurs interactions avec chaque site Web et application, basées sur l’approche utilisée en 2015. Les ratisseurs ont donc pu évaluer les sites Web et les applications selon des normes semblables.

Les questions portaient sur cinq indicateurs, qui reflétaient largement ceux du ratissage de 2015. Cependant, il est important de noter que les questions auxquelles les ratisseurs ont répondu en 2025 étaient plus détaillées que celles posées il y a dix ans, ce qui a limité notre capacité à établir certaines comparaisons avec les résultats précédents. Les indicateurs, qui sont décrits plus en détail dans les sections ci-dessous, étaient les suivants :

- Contrôle de l’âge

- Collecte de données sur les enfants

- Mesures de protection

- Suppression de compte

- Autres préoccupations générales

Les ratisseurs ont été invités à documenter leurs interactions avec le contenu et les fonctionnalités des sites Web et des applications – notamment les paramètres de confidentialité, les politiques de confidentialité et les processus de création et de suppression d’un compte – au moyen du formulaire de ratissage qui leur était fourniNote de bas de page 2. Certains chiffres présentés dans le rapport excluent les réponses laissées vierges à certaines questions dans le formulaire de ratissage, ce qui explique le léger écart dans le nombre total de sites Web et d’applications examinés.

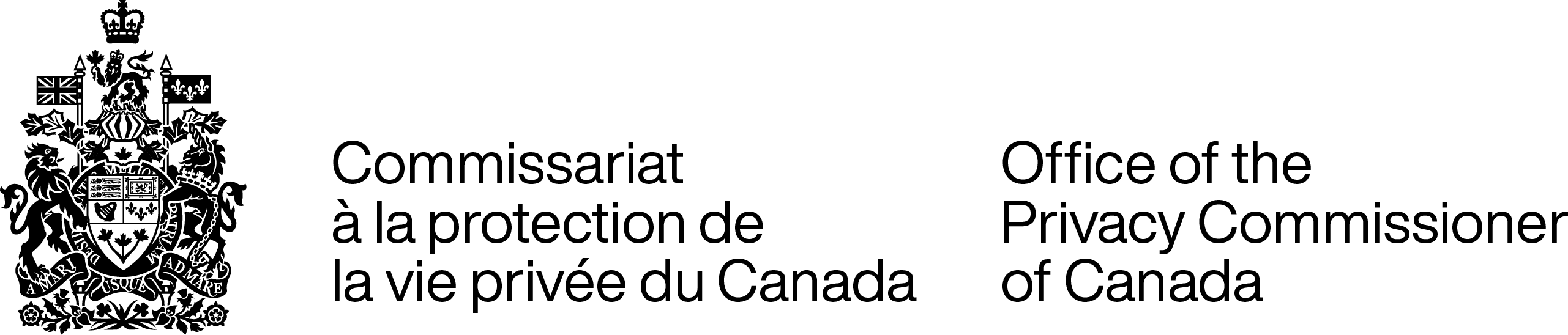

Sous le thème de la protection de la vie privée des enfants, chaque autorité participante a choisi l’objet de son ratissage, par exemple en sélectionnant des sites Web ou des applications dans des secteurs donnés correspondant à ses priorités stratégiques. Le graphique ci-dessous (figure 1) illustre la répartition par secteur des sites Web et des applications examinés dans le cadre du ratissageNote de bas de page 3 :

Version textuelle de la figure 1

| Secteur | Pourcentage |

|---|---|

| Éducation | 23 % |

| Jeux vidéo | 18 % |

| Santé et activité physique | 2 % |

| Écoute de musique en ligne | 2 % |

| Retouche de photos | 1 % |

| Cybercommerce | 11 % |

| Médias sociaux | 15 % |

| Diffusion de vidéos | 8 % |

| Autre | 20 % |

Contrôle de l’âge (indicateur 1)

Approches en matière de contrôle de l’âge

Le contrôle de l’âge comprend des mécanismes pour évaluer l’âge d’un enfant afin que son accès à un service en ligne ou ses interactions avec celui-ci puissent être adaptés ou restreints en conséquence. Il existe différentes approches du contrôle de l’âge. On trouve, entre autres, les mécanismes suivants :

- déclaration volontaire (l’utilisateur indique son âge, mais il n’est pas tenu de fournir des preuves pour le confirmer);

- vérification de l’âge (on demande à l’utilisateur de confirmer son âge, p. ex. en fournissant une pièce d’identité);

- estimation de l’âge (l’âge de l’utilisateur est estimé, souvent au moyen d’algorithmes, par exemple en estimant l’âge de son visage).

Mécanismes de contrôle de l’âge observés dans le cadre du ratissage

Les ratisseurs ont indiqué que les conditions d’utilisation de 62 % de tous les sites Web et applications examinés (517 sur 832)Note de bas de page 4 limitaient explicitement l’accès aux utilisateurs ayant atteint un certain âge, le plus souvent 13 ans. Parmi ces sites Web et ces applications, 32 % (164 sur 517) n’utilisaient aucun mécanisme de contrôle de l’âge. Quant aux autres sites Web et applications (68 %, ou 353 sur 517) utilisant des mécanismes du contrôle de l’âge :

- la majorité utilisait la déclaration volontaire (88 %, ou 311 sur 353);

- une petite proportion utilisait la vérification de l’âge (11 %, ou 38 sur 353);

- un plus petit nombre encore utilisait l’estimation de l’âge (5 %, ou 19 sur 353)Note de bas de page 5.

Le type d’estimation de l’âge utilisé n’était pas toujours précisé, mais lorsqu’il l’était, il s’agissait toujours de l’estimation de l’âge du visage, qui nécessite de fournir une photo ou un égoportrait vidéo.

Contournement du contrôle de l’âge

Les résultats du ratissage ont montré que la déclaration volontaire, une approche du contrôle de l’âge basée sur la confiance, peut facilement être contournéeNote de bas de page 6. Les ratisseurs ont indiqué qu’ils avaient pu contourner les mesures de contrôle de l’âge dans 72 % (460 sur 641)Note de bas de page 7 des cas; il s’agissait le plus souvent d’une déclaration volontaire.

Dans certains cas, les sites Web et les applications qui utilisaient la déclaration volontaire avaient mis en place d’autres mécanismes pour bloquer l’accès aux utilisateurs qui n’avaient pas l’âge requis, entre autres des questions mathématiques simples, des demandes de consentement parental et l’impossibilité de modifier l’âge entré au moment de la déclaration volontaire initiale. Cependant, les ratisseurs ont signalé qu’il était facile de contourner ces mesures, par exemple en réinstallant l’application ou en effaçant les témoins.

Contenu inapproprié et traitement des données à haut risque

Comme il est facile de la contourner, la déclaration volontaire peut difficilement à elle seule empêcher les enfants d’être exposés à du contenu inapproprié ou à des éléments de conception et de traitement des données à haut risque lorsque ceux-ci sont présents sur des sites Web et des applications utilisés par les enfants. (Voir les pages 15 à 18 pour connaître les types de contenu ainsi que les éléments de conception et de traitement des données recherchés par les ratisseurs.)

Sur la proportion de 34 % des sites Web et applications (288 sur 826)Note de bas de page 8 qui ont été désignés par les ratisseurs comme offrant un contenu inapproprié pour les enfants, 24 % (68 sur 288) ne disposaient d’aucun mécanisme de contrôle de l’âge. Toutefois, lorsqu’un mécanisme de contrôle de l’âge était en place, il s’agissait d’une déclaration volontaire dans 90 % (161 sur 179) des cas. De même, sur la proportion de 38 % des sites Web et applications (317 sur 824)Note de bas de page 9 désignés par les ratisseurs comme présentant des éléments de conception et de traitement des données à haut risque pour les enfants, 24 % (76 sur 317) ne disposaient d’aucun mécanisme de contrôle de l’âge. Toutefois, lorsqu’un mécanisme de contrôle de l’âge était en place, il s’agissait d’une déclaration volontaire dans 89 % (169 sur 190) des cas.

Cela signifie que les enfants seraient en mesure d’accéder (entre autres) à des images à caractère sexuel et à du contenu violent ou encore d’interagir librement avec d’autres utilisateurs sur certains sites Web et certaines applications. On trouve à la page 15 d’autres résultats relatifs au contenu inapproprié et aux éléments de conception et de traitement des données à haut risque trouvés par les ratisseurs sur certains sites Web et dans certaines applications.

Qu’est-ce qui a changé au cours de la dernière décennie?

Les participants au ratissage de 2015 du GPEN ont indiqué que seulement 15 % des sites Web et des applications examinés utilisaient une forme de contrôle de l’âge. Dix ans plus tard, les ratisseurs ont rapporté que 45 % de tous les sites Web et applications examinés (397 sur 876) étaient dotés d’une forme de contrôle de l’âge, ce qui représente une augmentation de 30 %.

Sommaire des observations

Le contrôle de l’âge peut s’avérer un élément clé d’une approche globale visant à protéger les enfants et leur droit à la vie privée en ligne. Bien que les résultats du ratissage indiquent une hausse de l’utilisation des mécanismes de contrôle de l’âge au cours des dix dernières années, le seul recours à la déclaration volontaire (ou l’absence totale de contrôle de l’âge) est préoccupant dans le cas des sites Web et des applications que les ratisseurs ont identifié comme proposant un contenu inapproprié ou des éléments de conception et de traitement des données à haut risque pour les enfants. Lorsque les plateformes sont conçues pour les enfants ou qu’elles sont populaires auprès d’eux, les autorités participantes encouragent les services en ligne qui appliquent un mécanisme de contrôle de l’âge à veiller à ce qu’ils soient adaptés aux risques que présentent leurs plateformes pour les enfants et recueillent le minimum de renseignements personnels requis.

Collecte de données sur les enfants et mesures de protection (indicateurs 2 et 3)

Politiques de confidentialité

Les politiques de confidentialité jouent un rôle important lorsqu’il s’agit de permettre aux utilisateurs de prendre des décisions éclairées et judicieuses en matière de protection de la vie privée. Une politique de confidentialité bien conçue instaure la confiance en définissant des attentes claires sur la manière dont les renseignements personnels des individus seront recueillis, utilisés et communiqués par une organisation.

Comme prévu, les ratisseurs ont constaté que la plupart des sites Web et des applications (96 %, ou 825 sur 862)Note de bas de page 10 comportaient une politique de confidentialité. Toutefois, ils ont constaté qu’il y avait des progrès à faire. Par exemple, certaines politiques contenaient peu d’information, tandis que d’autres étaient longues et difficiles à comprendre.

Les ratisseurs ont également constaté que 85 % des sites Web et des applications (705 sur 825) indiquaient dans leur politique de confidentialité que des renseignements personnels pourraient être échangés avec des tiers. Il s’agit d’une hausse importante par rapport à la proportion de 51 % rapportée lors du ratissage de 2015. On pourrait donc déduire que la dépendance à l’égard des tiers a augmenté, probablement en raison de l’évolution des modèles de revenus, des pratiques commerciales et des écosystèmes.

Collecte de renseignements personnels

Les ratisseurs ont constaté que certaines catégories de renseignements personnels faisaient plus souvent l’objet d’une collecte que d’autres. Pour donner accès à l’ensemble des fonctionnalités de leurs plateformes, 50 % des sites Web et des applications examinés (437 sur 876) demandaient un nom d’utilisateur, 59 % (519 sur 876), une adresse courriel et 46 % (399 sur 876), la géolocalisation.

D’autres types de renseignements personnels ont été recueillis moins souvent. Par exemple, les intérêts personnels (253 sur 876) et les caractéristiques personnelles (257 sur 876) ont été recueillis par moins de 30 % des sites Web et des applications ayant fait l’objet du ratissage.

Dans l’ensemble, les ratisseurs ont constaté une augmentation de la collecte de certains types de renseignements personnels par rapport à ce qui avait été observé en 2015. Par exemple :

| Renseignements personnels | 2015 | 2025 |

|---|---|---|

| Nom | 29 % obligatoire/12 % facultatif | 41 % obligatoire/23 % facultatif |

| Numéro de téléphone | 12 % obligatoire/10 % facultatif | 18 % obligatoire/28 % facultatif |

| Adresse | 11 % obligatoire/8 % facultatif | 12 % obligatoire/18 % facultatif |

| Photos ou vidéos | 9 % obligatoire/14 % facultatif | 5 % obligatoire/40 % facultatif |

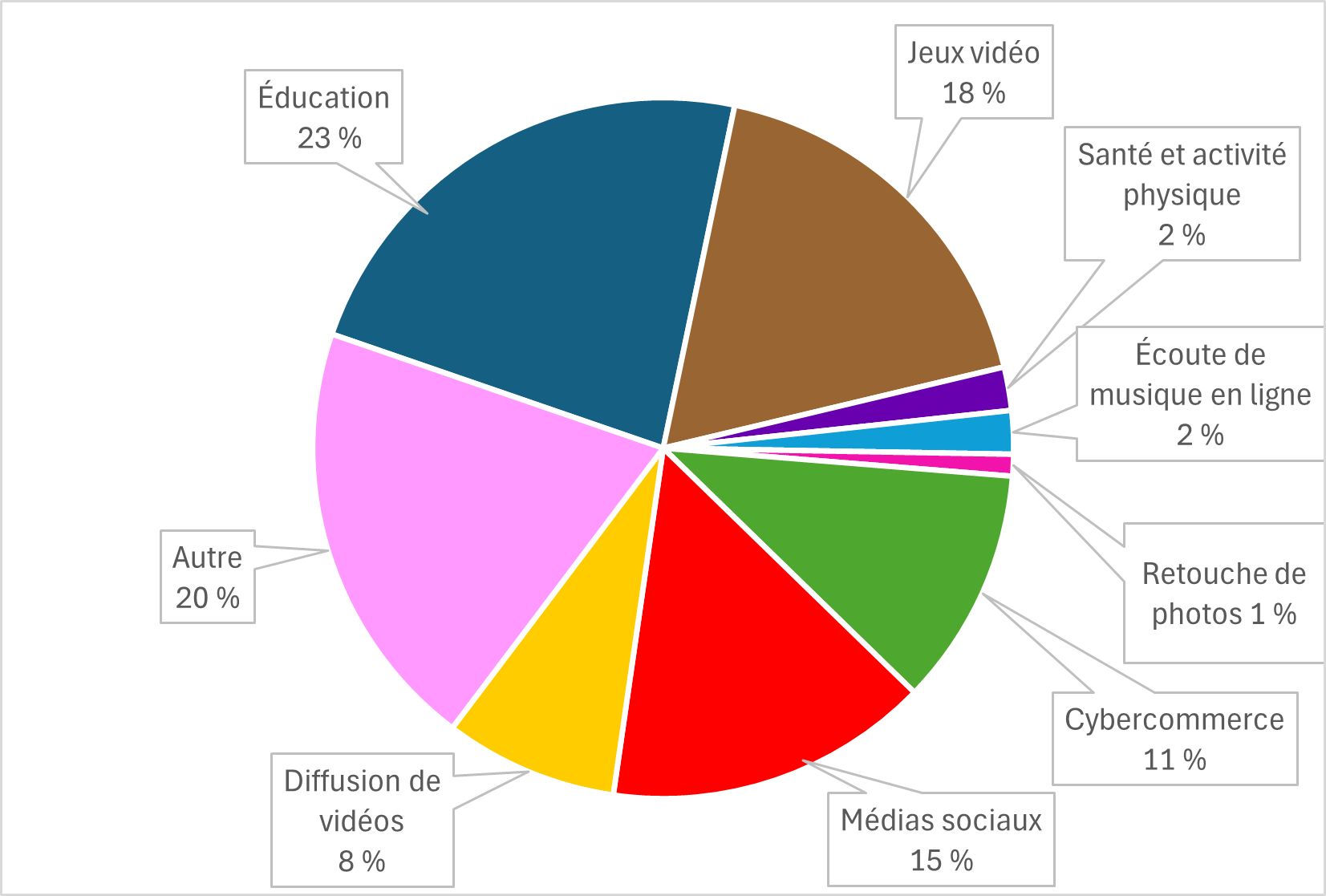

De plus, les ratisseurs ont observé que 41 % (341 sur 825) des politiques de confidentialité indiquaient explicitement que les sites Web ou les applications ne recueillaient pas sciemment les renseignements personnels des enfants. Parmi ces sites Web et ces applications, 25 % (86 sur 341) ciblaient précisément les enfants. Pourtant, les ratisseurs ont noté que certains types de renseignements personnels étaient quand même recueillis de manière obligatoire, entre autres le nom (30 %, soit 26 sur 86), l’adresse courriel (56 %, soit 48 sur 86), le nom d’utilisateur (56 %, soit 48 sur 86) et les photos ou vidéos (5 %, soit 4 sur 86). En outre, bien que 54 % des sites Web et des applications (184 sur 341)Note de bas de page 11 dont la politique de confidentialité contenait cette mention ne ciblaient pas spécialement les enfants, les ratisseurs ont constaté qu’ils étaient tout de même populaires auprès d’eux et que ces derniers les utilisaient couramment. Cette constatation soulève des préoccupations quant à la collecte de renseignements personnels concernant des enfants qui en résulte, puisque les ratisseurs ont signalé que bon nombre des sites Web et des applications obligeaient leurs utilisateurs à fournir des renseignements personnels, comme le montre le graphique ci-dessous.

Figure 2. Collecte obligatoire de renseignements personnels sur les sites Web et les applications ayant déclaré qu’ils ne recueillent pas sciemment les renseignements personnels des enfants

Version textuelle de la figure 2

| Collecte de renseignements personnels | Pourcentage |

|---|---|

| Nom | 42 % |

| Nom d’utilisateur | 50 % |

| Courriel | 62 % |

| Adresse | 13 % |

| Numéro de téléphone | 15 % |

| Photos, vidéos et fichers audio | 5 % |

Mesures de protection

Les mesures de protection sont des mécanismes mis en œuvre par les organisations exploitant des sites Web et des applications afin de limiter la collecte de renseignements personnels à ce qui est nécessaire et de réduire le risque de préjudice pour les utilisateurs. Il peut s’agir, par exemple, des incitatifs encourageant la participation des parents, d’avertissements au moment de quitter le site, d’avatars ou de noms d’utilisateur prédéfinis ou encore de forums de discussion ou de salons de clavardage modérés afin d’éviter la communication involontaire de renseignements personnels.

Comme en 2015, les ratisseurs ont constaté de bonnes pratiques dans l’utilisation des mesures de protection en 2025. Par exemple :

- Possibilité pour les parents d’approuver les invitations de nouvelles personnes (ou d’activer un « mode ami » dans lequel l’enfant est libre d’accepter les invitations de nouvelles personnes);

- Affichage de mises en garde contre l’utilisation du nom réel ou le téléchargement d’images sur le site Web ou l’application telles que des fenêtres contextuelles conseillant de ne pas inclure de renseignements personnels dans le nom d’utilisateur, ou la génération de noms d’utilisateur aléatoires durant le processus d’inscription;

- Désactivation par défaut du partage de position et de l’accès aux contacts;

- Possibilité de refuser l’utilisation de la localisation ou de choisir de partager seulement la localisation générale;

- Affichage de conseils sur la protection de la vie privée prévenant les utilisateurs de ne pas communiquer de renseignements personnels lorsqu’ils interagissent avec un robot conversationnel;

- Filtrage des publications et des messages des utilisateurs âgés de 12 ans ou moins afin d’empêcher la communication de renseignements personnels;

- Pour les sites Web éducatifs destinés aux enfants, restriction de la création de comptes pour enfants aux enseignants et approbation du contenu par les parents.

Cependant, les ratisseurs ont également identifié plusieurs pratiques préoccupantes sur de nombreux sites Web et applications. Par exemple :

- Dans seulement 56 % des sites Web et applications examinés (442 sur 794)Note de bas de page 12, les renseignements personnels recueillis étaient par défaut définis comme étant privés;

- Dans 47 % des sites Web et applications examinés (393 sur 828)Note de bas de page 13, les ratisseurs ont été redirigés vers un autre site Web ou une autre application où on pouvait leur demander de communiquer des renseignements personnels. Nous notons que ce chiffre était plus élevé en 2015 (58 %);

- Parmi les sites Web et applications examinés, 71 % (589 sur 827)Note de bas de page 14 ne contenaient pas de messages sur les mesures de protection et les pratiques en matière de protection de la vie privée adaptées aux enfants (p. ex. langage simple, animations destinées aux enfants);

- Parmi la proportion de 38 % des sites Web et applications (317 sur 824)Note de bas de page 15 où les ratisseurs ont trouvé des éléments de conception et de traitement des données à haut risque pour les enfants (p. ex. profilage comportemental, géolocalisation par défaut ou incitation à partager des renseignements personnels avec autrui), seulement 25 % (80 sur 317) disposaient de tableaux de bord parentaux et 35 % (112 sur 317) présentaient des messages sur la protection de la vie privée qui encourageaient la participation des parents;

- De même, sur la proportion de 35 % des sites Web et applications examinés (288 sur 826)Note de bas de page 16 qui proposaient du contenu pouvant être considéré comme inapproprié pour les enfants (p. ex. représentation de violence, contenu haineux, sexualité), seuls 35 % (100 sur 288) présentaient des messages sur la protection de la vie privée qui encourageaient la participation des parents et 27 % (79 sur 288) disposaient de tableaux de bord parentaux;

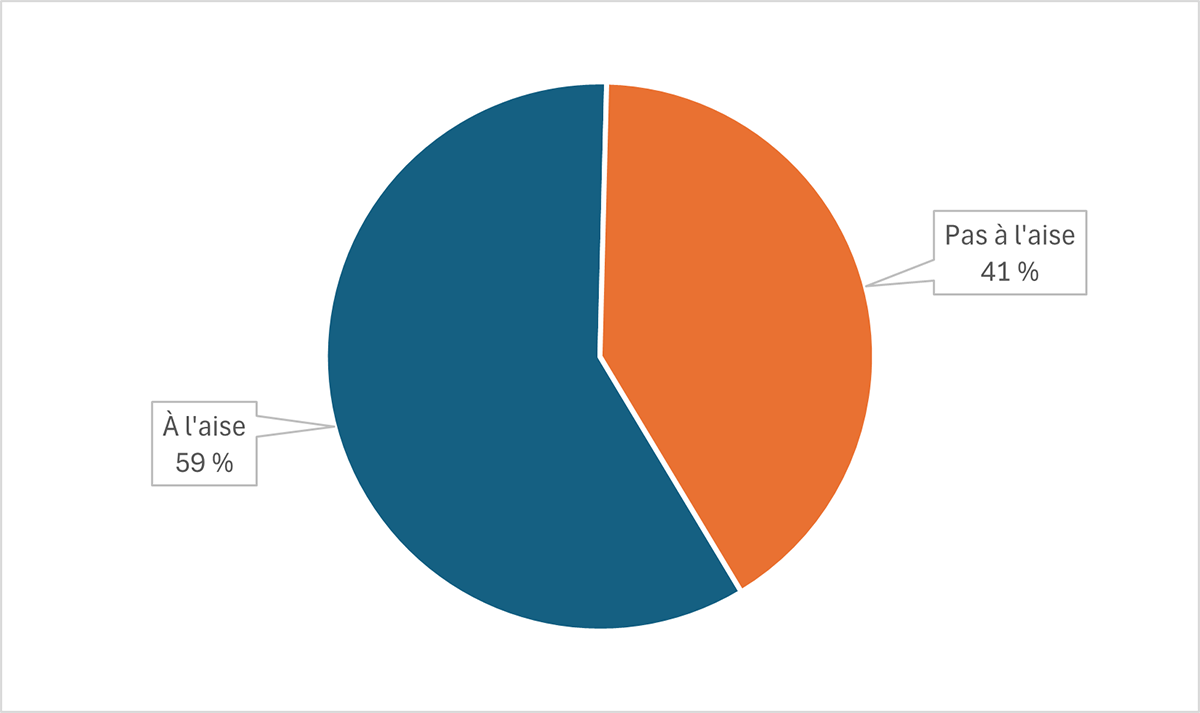

- Dans le cadre d’une évaluation générale de chaque site Web et application examiné, on a demandé aux ratisseurs s’ils seraient à l’aise de laisser un enfant utiliser le site Web ou l’application, en fonction de leur expérience du service. Les ratisseurs ont indiqué qu’ils ne seraient pas à l’aise que des enfants utilisent 41 % (343 sur 833)Note de bas de page 17 des sites Web et des applications. Seulement 19 % (64 sur 343) de ces plateformes étaient répertoriées comme ayant des mesures de protection qui limitaient efficacement la collecte de renseignements personnels.

Sommaire des observations

Bien que les ratisseurs aient relevé quelques bons exemples de messages et de mesures en matière de protection de la vie privée, ils ont également observé des pratiques préoccupantes qui pouvaient nuire à la compréhension et mener à une collecte excessive de renseignements personnels sur les enfants.

Les autorités participantes encouragent les organisations à veiller à ce que leurs politiques de confidentialité reflètent et expliquent clairement leurs pratiques en matière de traitement des données, en tenant compte de la diversité potentielle et de l’âge de leurs bases d’utilisateurs. Le contenu des politiques de confidentialité doit être complet et facile à comprendre. Les plateformes devraient également disposer de moyens créatifs et accessibles d’expliquer leurs pratiques en matière de protection de la vie privée. Les organisations peuvent responsabiliser les jeunes utilisateurs et leurs parents en adaptant les communications sur la protection de la vie privée aux utilisateurs visés et en rendant les mesures de protection de la vie privée faciles à trouver et à utiliser.

Les organisations devraient examiner attentivement si la collecte de renseignements personnels auprès des enfants est nécessaire et proportionnelle à la prestation des services, et veiller à ce que la vie privée des jeunes utilisateurs soit protégée dès la conception et par défaut.

Le cas échéant, les plateformes devraient également encourager et faciliter la participation des parents afin qu’ils puissent guider ou soutenir leurs enfants dans la prise de décisions judicieuses concernant leur vie privée.

Suppression de compte (indicateur 4)

Pourquoi la suppression de compte est-elle importante pour les enfants?

En permettant aux enfants de supprimer facilement leur compte, on les aide à gérer adéquatement leurs renseignements personnels et à quitter un service qu’ils ne souhaitent plus utiliser. S’il est difficile de trouver comment supprimer un compte ou si la procédure est complexe, il est possible que les enfants continuent d’utiliser le service plus longtemps que prévu, augmentant ainsi l’exposition à du contenu non désiré. De plus, leurs renseignements personnels peuvent être conservés pendant une période prolongée, ce qui accroît les risques de traitement indésirable des données à l’avenir.

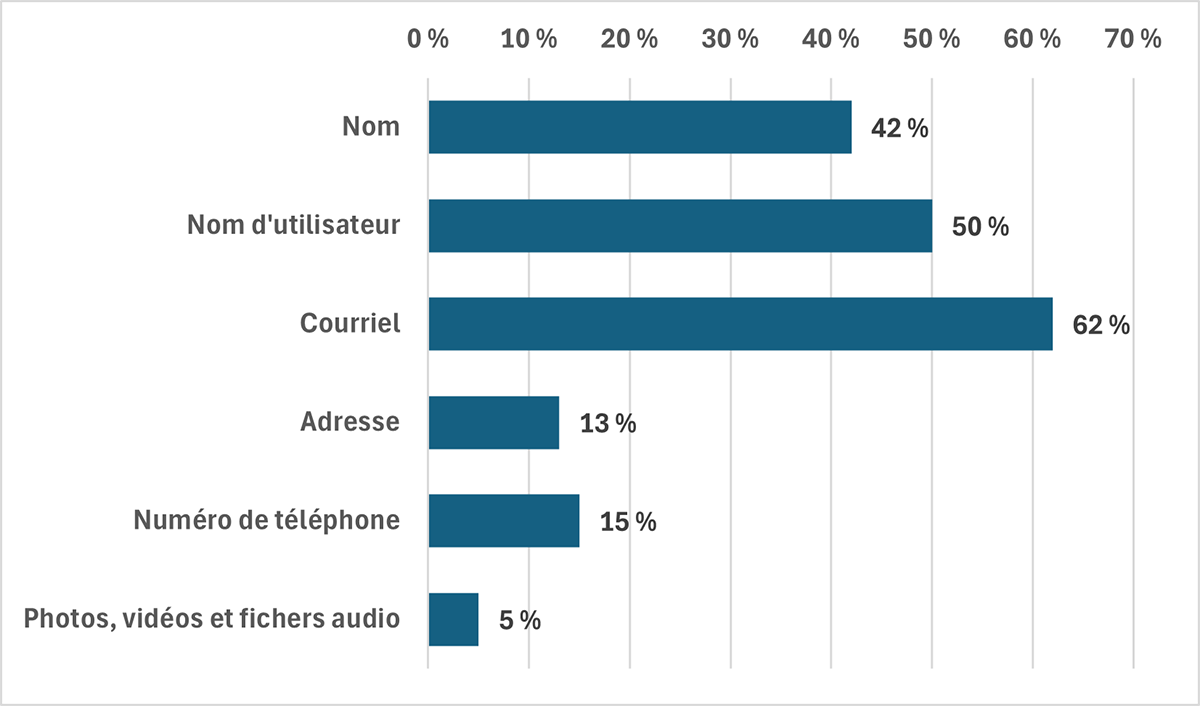

On a demandé aux ratisseurs d’évaluer si les options de suppression de compte étaient faciles à trouver et à utiliser, en se basant sur le nombre d’étapes nécessaires et sur la clarté des renseignements fournis.

Ce que les ratisseurs ont observé

Les observations des ratisseurs concordent avec les résultats du rapport du GPEN de 2024 intitulé « Mécanismes de conception trompeuse »Note de bas de page 18, les ratisseurs ayant indiqué que 64 % des sites Web et des applications (481 sur 755)Note de bas de page 19 disposaient d’un processus de suppression de compte accessible (facile à trouver et à comprendre), tandis que 36 % (274 sur 755) n’en avaient pas. Dans le cas des services où la suppression de compte a été jugée non accessible (fonction difficile à trouver et à comprendre), les ratisseurs ont indiqué que les options de suppression étaient souvent dissimulées dans de multiples menus, que les utilisateurs étaient redirigés vers de longues pages d’aide ou des processus de soutien externe ou alors qu’ils devaient communiquer avec le service à la clientèle au lieu de pouvoir supprimer eux-mêmes leur compte. Dans certains cas, les ratisseurs ont décrit ces processus comme étant « laborieux » et « pratiquement impossibles [à réaliser] par des enfants ».

Figure 3. Facilité d’accès à la fonction de suppression de compte

Version textuelle de la figure 3

| Facilité d’accès | Pourcentage |

|---|---|

| Facile à trouver | 64 % |

| Difficile à trouver | 36 % |

Qu’est-ce qui a changé au cours des dix dernières années?

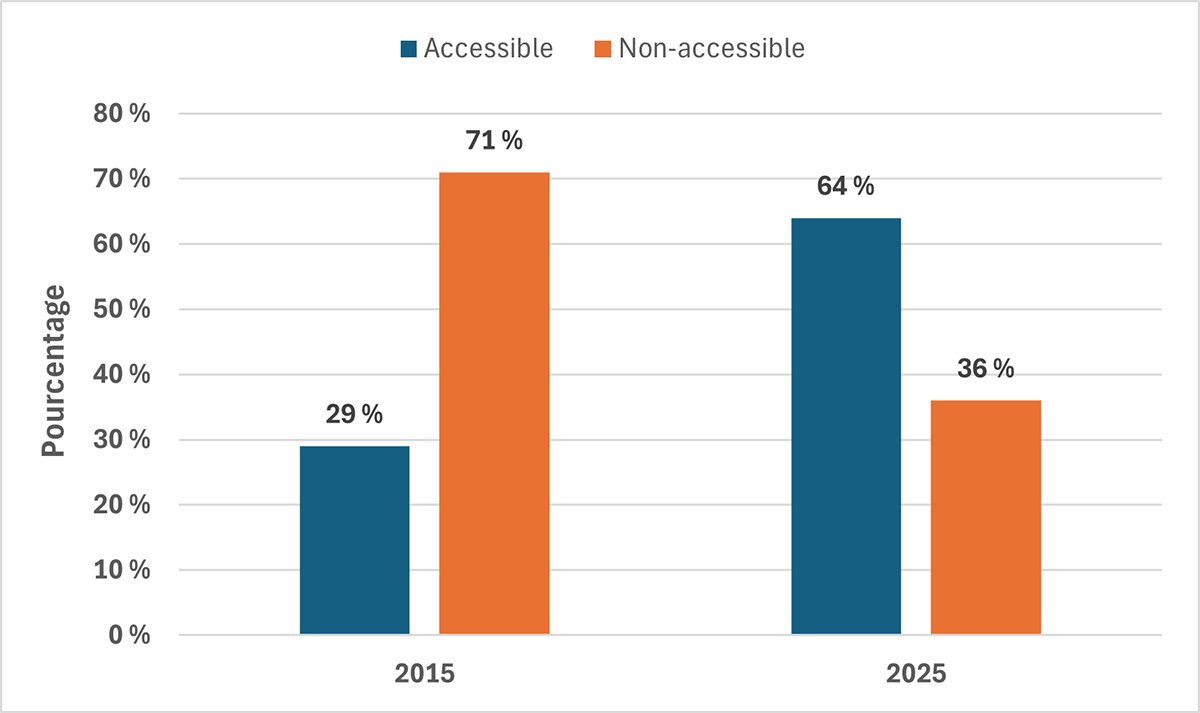

Les participants au ratissage de 2015 du GPEN ont indiqué que seulement 29 % des sites Web et des applications examinés offraient des moyens accessibles de supprimer un compte. Dix ans plus tard, 35 % plus de sites Web et d’applications proposent désormais des options de suppression accessibles, passant de 29 % à 64 %.

Figure 4. Progrès réalisés sur dix ans en ce qui a trait à l’accessibilité de la fonction de suppression de compte

Version textuelle de la figure 4

| Accessibilité | 2015 | 2025 |

|---|---|---|

| Accessible | 29 % | 64 % |

| Non-accessible | 71 % | 36 % |

Sommaire des observations

La facilité avec laquelle les comptes peuvent être supprimés est une mesure importante de la capacité d’une personne à garder le contrôle sur ses renseignements personnels. Les résultats du ratissage montrent que des progrès importants ont été réalisés au cours des dix dernières années pour rendre les options de suppression de compte plus faciles à trouver. Cependant, plus d’un tiers des sites Web et des applications examinés n’offrent toujours pas de moyen accessible de supprimer un compte. Le fait que les utilisateurs puissent supprimer eux-mêmes leur compte de façon simple est un facteur important pour la sécurité des enfants, surtout compte tenu du fait que le lien qu’entretiennent les enfants avec les services en ligne évolue au fil du temps.

Contenu inapproprié et éléments de conception et de traitement des données à haut risque (indicateur 5)

Les ratisseurs ont évalué si les sites Web et les applications présentaient du contenu susceptible d’être inapproprié pour les enfantsNote de bas de page 20 ainsi que des éléments de conception et de traitement des données qui pouvaient représenter un risque élevé pour euxNote de bas de page 21.

Exposition à du contenu préjudiciable

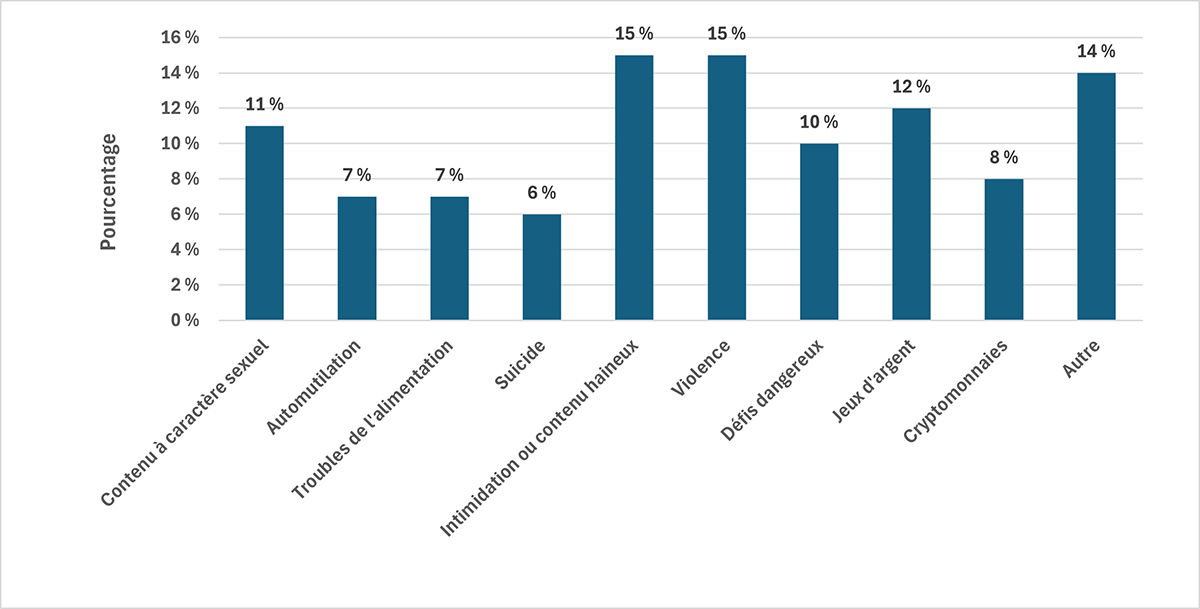

Les ratisseurs ont identifié du contenu préoccupant sur une grande proportion des sites Web et des applications (voir le graphique ci-dessous)Note de bas de page 22. Du contenu d’intimidation, offensant ou haineux a été vu dans 15 % des services (127 sur 876), tandis que du contenu à caractère sexuel apparaissait dans 11 % des services (94 sur 876). Du contenu relatif à l’automutilation était présent dans 7 % des services (65 sur 876), une proportion similaire au contenu relatif aux troubles de l’alimentation (7 %, ou 64 sur 876).

Figure 5. Proportion de sites Web et d’applications présentant du contenu inapproprié, par type

Version textuelle de la figure 5

| Type de sites Web et d'applications | Pourcentage |

|---|---|

| Contenu à caractère sexuel | 11 % |

| Automutilation | 7 % |

| Troubles de l’alimentation | 7 % |

| Suicide | 6 % |

| Intimidation ou contenu haineux | 15 % |

| Violence | 15 % |

| Défis dangereux | 10 % |

| Jeux d’argent | 12 % |

| Cryptomonnaies | 8 % |

| Autre | 14 % |

Ces résultats indiquent que les enfants qui utilisent certains sites Web et certaines applications populaires risquent d’être exposés à du contenu préjudiciable. Les ratisseurs ont noté que ce type de contenu apparaissait dans les sections où le contenu était généré par les utilisateurs, dans le clavardage et dans les fils algorithmiques.

Quand contenu préjudiciable et éléments à risque se rencontrent

La combinaison de contenu inapproprié et d’éléments de conception à haut risque peut accroître davantage le risque. Par exemple, en utilisant les sites Web et les applications et en examinant leurs communications relatives à la protection de la vie privée, les ratisseurs ont constaté que le profilage comportemental (c’est-à-dire le suivi et l’analyse du comportement de l’utilisateur afin de prédire ses intérêts et de lui proposer du contenu) était associé à du contenu sur l’automutilation dans 60 % des cas (39 sur 65) et à du contenu sur les troubles alimentaires dans 58 % des cas (37 sur 64). Cette association est particulièrement troublante, car elle suggère que certaines plateformes n’ont peut-être pas mis en œuvre les mesures appropriées pour empêcher le profilage des enfants et la diffusion de contenu préjudiciable à leur santé et à leur bien-être.

Risques liés aux services destinés aux enfants

Les ratisseurs ont noté que, dans certains cas, même les services destinés aux enfants comportaient des éléments de conception et de traitement des données à haut risque. Par exemple, ils ont déclaré que 6 % (18 sur 284) de ces plateformes utilisaient le profilage comportemental. Parmi ces plateformes, 39 % (7 sur 18) présentaient également du contenu d’intimidation ou offensant, tandis que 28 % (5 sur 18) montraient du contenu violent.

Les ratisseurs ont exprimé des inquiétudes face à ces résultats. Par exemple, un ratisseur a observé qu’un service « clairement conçu pour les jeunes enfants » incluait « un suivi étendu du comportement dans l’application sans visibilité ni contrôle parental », tandis qu’un autre a noté que « du contenu généré par les utilisateurs et représentant de la violence apparaissait dans le fil aux côtés de publications éducatives ».

Adaptation générale à l’utilisation par les enfants

Comme il est mentionné ci-dessus, on a demandé aux ratisseurs s’ils seraient à l’aise de laisser un enfant utiliser le site Web ou l’application en question, en tenant compte à la fois de ses pratiques en matière de protection de la vie privée ainsi que de tout contenu inapproprié et des éléments de conception et de traitement des données à haut risque. Il faut noter qu’il s’agissait d’une évaluation subjective, mais les ratisseurs ont indiqué qu’ils n’étaient pas à l’aise que des enfants utilisent 41 % (343 sur 833)Note de bas de page 23 des sites Web et des applications examinés.

Figure 6. Adaptation générale à l’utilisation par les enfants

Version textuelle de la figure 6

| Niveau de confort | Pourcentage |

|---|---|

| À l’aise | 59 % |

| Pas à l’aise | 41 % |

Les ratisseurs ont ciblé une série de facteurs contribuant à leur inconfort lié à l’utilisation des sites Web et des applications par les enfants. Ils ont notamment mentionné l’exposition à du contenu violent ou à caractère sexuel, précisant même que, dans certains cas, les services présentaient « du contenu classé pour les 18 ans ou plus, d’une violence extrême, sexuellement explicite ou portant sur d’autres thèmes destinés aux adultes ». Les ratisseurs ont également relevé des interactions sans restriction avec les autres utilisateurs, en particulier par l’intermédiaire de fonctions de clavardage et de fonctionnalités de communauté qui permettaient aux enfants d’interagir librement avec des inconnus.

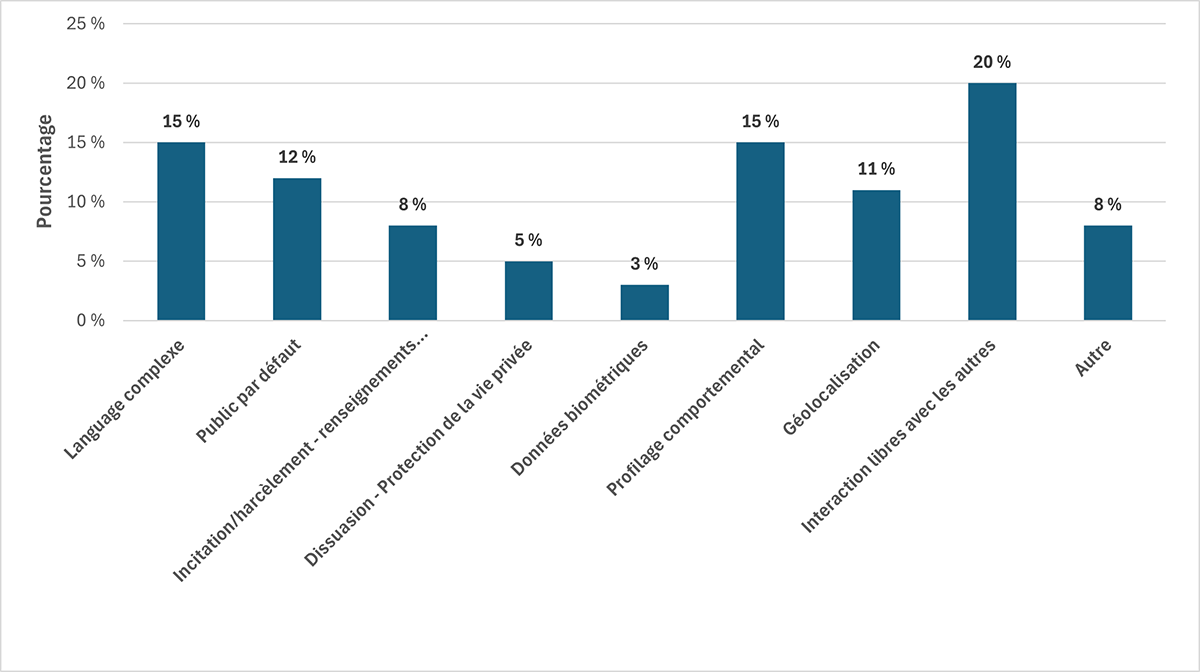

Des éléments de conception encourageant un engagement prolongé ou répété ont été notés, de même que des pratiques de monétisation susceptibles d’exercer une pression sur les enfants, notamment des bannières publicitaires qui « peuvent diriger l’enfant à des endroits inappropriés ». Les ratisseurs ont également observé des pratiques de profilage, de suivi et d’autres méthodes de traitement de données à haut risque, certains signalant que les technologies de suivi semblaient recueillir des renseignements « sans mesures permettant d’interrompre la collecte » pour les jeunes utilisateurs. Dans bon nombre de cas, les ratisseurs ont noté la présence de plus d’un facteur (voir le graphique ci-dessous)Note de bas de page 24.

Figure 7. Proportion de sites Web et d’applications comportant des éléments de conception inadéquats, par type

Version textuelle de la figure 7

| Type de sites Web et d’applications | Pourcentage |

|---|---|

| Langage complexe | 15 % |

| Public par défaut | 12 % |

| Incitation ou harcèlement pour communiquer des renseignements personnels (RP) | 8 % |

| Dissuasion – utilisation des options de protection de la vie privée | 5 % |

| Données biométriques | 3 % |

| Profilage comportemental | 15 % |

| Géolocalisation | 11 % |

| Interactions libres avec les autres | 20 % |

| Autre | 8 % |

Comparaison des sites Web et des applications

Le ratissage a permis de découvrir de légères différences entre les types de plateformes. De façon générale, les ratisseurs étaient plus à l’aise que les enfants utilisent les sites Web que les applications : 59 % des sites Web (275 sur 464) ont été jugés appropriés, comparativement à 53 % des applications (212 sur 400).

Cet écart suggère que les applications mobiles peuvent présenter des défis particuliers en matière de sécurité des enfants, possiblement en raison de différences dans les fonctionnalités, les pratiques de collecte de données ou les caractéristiques d’interaction.

Services gratuits et sécurité des enfants

L’analyse des données révèle également des différences en fonction de la manière dont les services génèrent des revenus. Les services payants ont été jugés appropriés pour les enfants dans 61 % des cas (117 sur 193), comparativement à 53 % pour les services gratuits (345 sur 648).

Cette tendance est peut-être le reflet de différences dans les modèles d’affaires et les mesures incitatives qui en découlent. Les services qui génèrent des revenus grâce à des abonnements sont peut-être moins dépendants d’une monétisation basée sur les données ou des fonctionnalités visant à maximiser l’engagement, qui peuvent être problématiques pour les enfants. Les services gratuits, en revanche, peuvent être plus enclins à recourir à de telles pratiques.

Sommaire des observations

Les résultats du ratissage révèlent qu’une proportion importante de services exposent les enfants à du contenu préjudiciable et les soumettent à des éléments de conception et de traitement des données à haut risque. Les ratisseurs ont souvent signalé la présence, au sein d’un même service, de contenu préjudiciable et d’éléments de conception à haut risque, ce qui est susceptible d’accroître les risques pour les enfants. Les autorités participantes encouragent les services en ligne à concevoir les plateformes utilisées par des enfants d’une manière appropriée pour ceux-ci, notamment en veillant à ce que le contenu auquel les enfants sont exposés et les fonctionnalités mises à leur disposition soient adaptés à leur âge.

Conclusion

Le ratissage du GPEN vise à encourager les organisations à respecter les lois sur la protection de la vie privée et des données, tout en favorisant la collaboration entre les autorités d’application des lois en matière de protection de la vie privée du monde entier. Même si le ratissage du GPEN n’est pas en soi une enquête et ne vise pas à identifier de façon définitive les problèmes de conformité ou les infractions aux lois, les préoccupations soulevées dans le cadre de cet exercice peuvent appuyer l’élaboration de conseils ciblés, des consultations avec les organisations et l’adoption de mesures d’application de la loi dans l’avenir.

Le bilan du ratissage de cette année est mitigé. Dans de nombreux sites Web et applications, les ratisseurs ont observé de bonnes pratiques pour protéger les enfants et leurs renseignements personnels. Toutefois, ils ont également observé des pratiques préoccupantes en ce qui concerne la protection de la vie privée des enfants qui laissent supposer que certains risques ont pu augmenter au cours des dix dernières années.

Par exemple, par rapport à 2015, il y a davantage de services en ligne conçus pour les enfants ou utilisés par eux qui exigent désormais que les utilisateurs fournissent leurs renseignements personnels pour accéder à l’ensemble des fonctionnalités de la plateforme ou qui communiquent les renseignements personnels fournis à des tiers. En outre, même si les mécanismes de contrôle de l’âge sont plus souvent utilisés qu’avant pour restreindre l’accès des enfants aux services en ligne et limiter leurs interactions avec ces derniers, les ratisseurs ont constaté que ces mesures pouvaient souvent être facilement contournées. C’est une situation préoccupante dans le cas des sites Web et des applications qui présentent du contenu inapproprié ou qui comportent des éléments de conception et de traitement des données à haut risque pour les enfants.

Chaque individu est en droit de s’attendre à ce que l’on protège ses renseignements personnels, en particulier les enfants qui naviguent dans l’espace numérique et utilisent des services en ligne. En adoptant des pratiques adaptées aux enfants, par exemple en limitant la collecte de renseignements personnels, en intégrant la protection de la vie privée par défaut dès la conception des services et en utilisant des mécanismes de contrôle de l’âge adaptés au niveau de risque de leurs plateformes, les organisations peuvent contribuer au bien-être des enfants en ligne.

Annexe A

Les autorités d’application des lois en matière de protection de la vie privée ci-dessous ont fourni leurs résultats :

- Commissariat à l’information de l’Australie

- Bureau du commissaire à la protection de la vie privée des Bermudes

- Agence nationale de protection des données (Agência Nacional de Proteção de Dados), Brésil

- Commissariat à l’information et à la protection de la vie privée de l’Alberta, Canada

- Commissariat à l’information et à la protection de la vie privée de la Colombie-Britannique, Canada

- Commissariat à la protection de la vie privée du Canada

- Commissariat à l’information et à la protection de la vie privée de l’Ontario, Canada

- Commission d’accès à l’information du Québec, Canada

- Commissariat à la protection de la vie privée et des données personnelles, Hong Kong, Chine

- Bureau de la protection des données personnelles, Macao, Chine

- Bureau d’inspection de la protection des données de l’Estonie

- Commission Nationale de l’Informatique et des Libertés, France

- Autorité de réglementation de Gibraltar

- Autorité de protection des données du bailliage de Guernesey

- Commissaire à l’information de l’île de Man

- Autorité israélienne de protection de la vie privée, Israël

- Autorité italienne de la protection des données (Garante per la Protezione dei dati personali), Italie

- Commission de protection des renseignements personnels, Japon

- Commissariat à l’information de Jersey

- Commissariat à l’information et à la protection des données, Malte

- Autorité de protection des données (Autoriteit Persoonsgegevens), Pays-Bas

- Commissariat à la protection de la vie privée de la Nouvelle-Zélande

- Datatilsynet, Norvège

- Commission nationale de la vie privée, Philippines

- Commissaire à l’information de la République de Slovénie

- Commissariat à l’information du Royaume-Uni

- Agence de protection de la vie privée de la Californie, États-Unis

- Date de modification :